月记·二零二六·一月

2026-01-01 ~ 2026-01-31.

月记

前言#

2026 的一月份还是充满了打工和迷茫的一个月,伴随着月初和乐小姐的短暂相聚结束,我完成了在学校本科的最后一次实验课,然后返回了上海,继续我在上海人工智能实验室的打工生活。具身智能中心对于我来说的主线依然是清晰的,伴随着伦哥的离职,我也就继续在汗青哥麾下工作,然后 contribute 到目前 Benchmark Platform 的开发中,并且在闲暇之余继续沉淀。

Benchmark Platform#

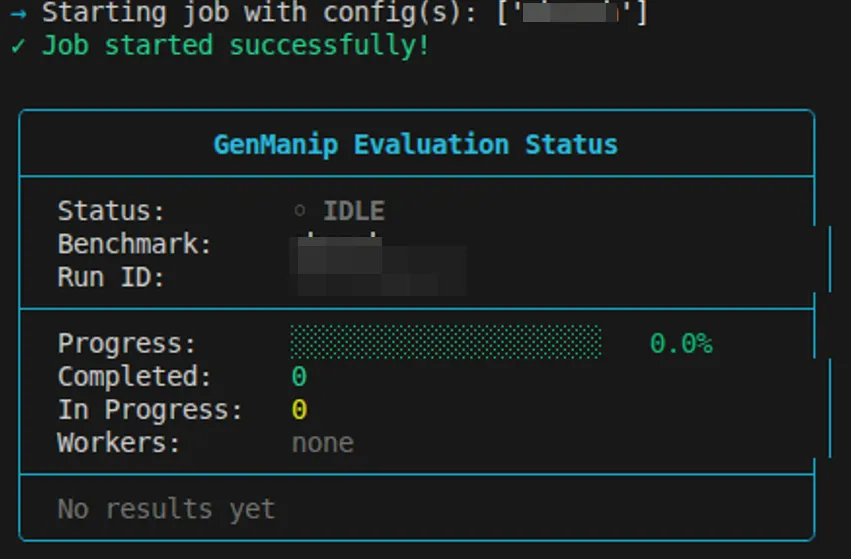

在 GenManip 延申为 GenManip Suite 之后,我带领工程师团队(姑且这样自夸)一直在打磨 GenManip Suite 的效果,包括说使用 Ray 进行资源管理,更合理且符合直觉的使用流程,以及更全面的文档和示例。我们制作了简单的 cli 工具以及一些相关的可视化,并且大量优化了测评相关的内容,使得测评如今可以像是提交任务一样,让一个 Benchmark 的 Server 长久地活在你的后台,动态增删资源调用,实时查看进度。

过程中的一些迭代结论比较有趣。对于设计一个 Benchmark Platform 来说,或者说一个可以高效可扩展地支持多个 Benchmark 的 Codebase 来说,这时候的视角变得不再是完成一个科研项目,而是设计一个产品,不少的视角需要从用户重新出发。

一个小的结论是,事实上美观性对于项目可以起到显著的作用。最近我在高强度使用 Codex 以及 Claude Code 这类 TUI Coding Agent 来进行高强度的 vibe coding,虽然说 Codex 的模型能力本身很强,但是日常使用中明显我更加倾向于使用 cc。一个显著的原因就是因为 cc 搭载的各种令人不明觉厉的内容,动态的 TUI、Planning Mode、若干的交互以及更加具体的反馈,使得用户在使用的过程中具有了一种“安全感”,这种安全感很大程度上来自于 presentation,而并非本质的功能,对于一个内容 solid 但是需要吸引别人使用,减轻别人的使用压力的项目来说,尤为如此。

因此我给项目的 cli 提供了美观的输出,立刻就让人心情愉悦了起来,大家的反馈也都还挺不错。值得一提的是,现在的交互非常的简单,大概就是:

python ray_server.py

gmp submit GenManipSuite/GenManip-Package-Basic # submit a benchmark

python model_client.py就可以开始测试。因为采用了 c/s 的设计,因此仿真端对于用户来说完全可以作为黑盒去使用,而仅暴露 fastapi 接口,同时我们几乎零依赖的 genmanip-client 包可以安装到用户的模型环境中,通过 from genmanip-client import EvalClient 即可自动建立通信,只需要用户对于类返回的 Obs 推理出来 Action 并且发回去即可,非常的干净。

同时我也在 Codebase 中添加了一些有趣的老本行,也就是通过 filesystem 来进行不同 ray_server.py 之间的进度同步,只要不同的程序共享文件系统,对于同一个 run-id 的任务,就可以同步进度。这件事的必要性也比较显然,因为对于整个中心来说,大量的同学都需要使用 Server 来进行测试,而 Server 要不然就持久地占有很多的资源,要不然就可能在非峰值使用的时候资源浪费,而在峰值使用的时候又供不应求。使用 DLC 来动态启动多个 Server,并且及时释放,可以使得整体的 Workflow 回到之前类似于将模型与仿真统一打 Docker 然后批量测试的感觉,而同时进度同步,也算是不错的 Feature。

这些情报姑且算是可以透露的,同时我们自己的 Benchmark 的 V1 基本上已经做的差不多了,之后就只需要在现有的基础上加入更多的 Domain Randomization(这事实上也是 GenManip 所擅长的方面之一),并且支持大量的 Baseline,就算是大功告成了。

关于 AI Infra#

最近另外一件一直在思考的事情就是关于自己应该去做什么的事情,什么可以组成自己博士生涯的主线,尽管现在我的博士生涯还没有开始。

一个有趣的事情是,我发现绝大多数的比较 Junior 的做 Robotics 相关的同学都比较仅限于将一些内容调 Work,而不在意里面非常细节的原理性内容;大多数做 VLM 和 GenAI 的同学则相对对于这种东西熟悉一些,不过更加注重原理以及 Insight 的挖掘;而这些领域中少数的非常出色的同学,才会对于 AI Infra 以及模型相关的内容同时比较精通。在这里的 Infra 主要指 Training Infra 相关的内容,尤其比如说 FSDP、Megatron 以及各种各样的分布式训练相关的技术。

按照我的判断来说,在 Scaling Law 的时代下,Insight 只有在训练尺寸足够大的模型,并且在足量的数据以及足够的卡上跑通,才可以被领悟,而这些内容毫无疑问,需要在一定的 AI Infra 之上实现。对于 LLM 以及 VLM 来说,在长久的发展之后,相关的内容已经比较成熟了,但是对于 Robotics 以及 VLA 来说,则基本上还没有开始发展。一个明显的缺口存在,而我们之前的一些探索,比如说 starVLA 已经占据了一定的先机,具有了一千 star,这在 VLA 领域已经算是十分优秀的成绩,而我们明显可以在这个基础上进一步拓展。

同时,想要将来在企业中成为那个可以训练千卡集群的人,明显自己在此之前就需要有不少的积累,比如说经常进行百卡的训练,对于各种优化手段都比较熟悉,这意味着自己之前一定要经常上手这些训练框架,亲自对于代码进行优化,并且进行大量的实验,这方面的积累是十分重要的。因此还是需要趁早上手,然后开始滚雪球,扩大自己可以接触的计算资源,增进自己的能力,并且让自己一直保持活跃。

同时,另外一件有趣的事情是,相较于 VLM 相关的领域来说,对于部署以及数据的内容,具身明显在诸如使用 SGLang 或者类似框架进行部分的优化之外,还包括着更多的讲究。比如说对于不同的真机的部署,一些真机部署上的经验、trick 甚至可能需要了解一些机器人的选型以及修理机器人的技术;对于数据以及测评,仿真管线里面需要踩的坑也同样不少。诸多可以拓展的内容带来了足够厚实的技术壁垒,同时也有挑战性,对于我来说,这可能是一个非常不错的方向。

正好之前也是一直在进行 GenManip 这一套仿真的迭代,以及 starVLA 关于 VLA 的迭代,因此也算是上车了,都可以打包到 Infra 的故事线里面。接下来就需要尽力而为,并且看看如何走得更远,也包括如何在中心里面对于不同的项目都有自己的 contribution。

同时,维护开源项目,或许放出一些 Tech Report 以及相关的 Blog,对于目前的我来说可能更加合适一些。在此之前大量的论文投稿的经验,实在是让我对于 Rebuttal 有着本能的反感,因此还是少发点论文吧,反正大概率也不缺。AI Infra 的另一个偏向功利的角度在于成为卖铲子的人,从而混到大量的 credit,对于提升身价也算是不错的方法。

最近看了 WhyNotTV 的播客,采访了 翁家翌,谈了不少关于 Infra 以及包括说开源项目类似的内容,还是颇有感触,深受鼓舞。或许 Infra 是对的,至少我暂时会尝试很长一段时间。

公主梦#

除此之外的内容,可能主要就是一月中旬乐小姐来找我玩了。

因为乐小姐过生日,再加上结束了久违的考试周(不得不再次感叹医学生的考试压力之大,或者说应该是考试月),于是开始了为期五天的上海之行。因为自己在 AILAB 的宿舍只是非常小的蜗居,因此不太适合将女朋友带过来,于是还是选择住了酒店。通过每天八点钟上班,加上灵活打卡的规定,从而可以每天五点钟下班,然后陪着乐小姐。

大概是一种巧合,但是总之乐小姐的生日恰好在周末,虽然说我们两个人对于迪士尼相关的 IP 并没有什么独到的喜好,但是毕竟从每个少女都有一个公主梦的角度来说,还是值得一去。于是我们就去了迪士尼。尽管是在周末,但是因为是冬天,以及中小学生还没有放假,因此人流量还算是一个可以接受的范畴。同时乐小姐不太能玩太刺激的项目,于是我们主要还是以拍照以及逛逛为主,于是没有漫长的排队,体验还算是不错。

同时,相较于之前乐小姐对我拍照技术的吐槽,这次终于有了足够长的时间上手我当初给乐小姐买的相机,并且锻炼自己的摄影技术,至少拍人现在不会很奇怪,也可以让她满意。

五天的时间好似一场梦过去,发生了很多有意思的事情,不过限于题材不便多说。总之很开心,也很充实。

结语#

这大概就是我一月份在做的事情,迭代主线,继续完成一个大型的项目,尝试 Track 不同的人,和他们开会对齐进度,锻炼自己的能力。不断思考,相较于之前还在思考仿真以及数据如何如何,如今跳出仿真的视角,从更大的 AI Infra 的角度明确方向,第一次确定将来自己的故事线。加上适当的闲暇。愿共勉。